媒体滚动|Google自研芯片启示录:不为跑分只为打磨体验( 三 )

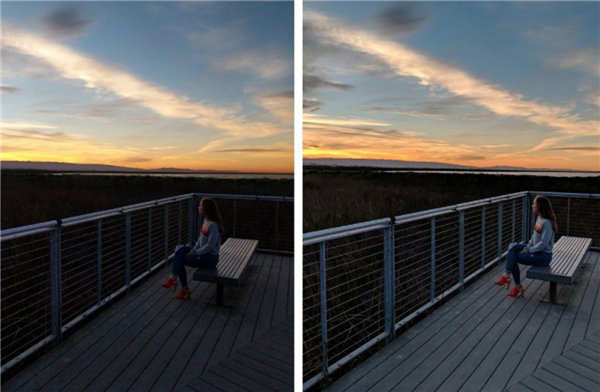

而到 Google Tensor 的硬件上 , Pixel 团队终于可以在针对性的定制硬件上来运行更多计算摄影所能实现的效果:作为本次新视频录制算法 —— HDRNet 的一部分 , Google 通过在 Tensor 中整合的计算单元 , 不仅实现了在 4K60FPS 视频录制时应用 HDR 效果 , 还解决了视频拍摄过程发热严重的问题:以往只能拍摄 4-5 分钟 , 到 Pixel 6 系列上则可以至少拍摄 20 分钟 。

文章图片

图7/10

终极解决方案

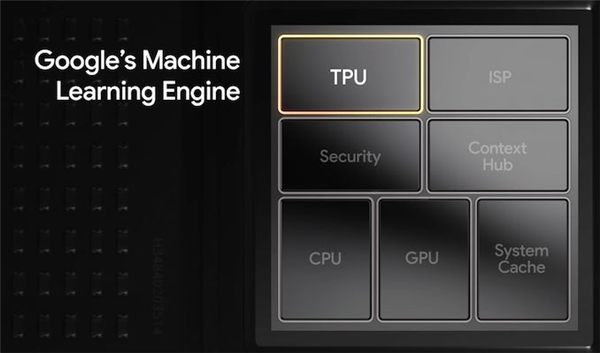

其实在 Google Tensor 之前 , Google 在给智能手机设计芯片这件事上 , 也走过类似当前小米/vivo 的阶段:如今负责研发 Tensor 的团队 , 其实早已在之前的 Pixel 手机中以加入协处理器的方式 , 来针对性提升手机某一部分的效能 。

比如 Pixel 2/3 时代用于提升计算摄影/HDR+ 算法处理速度的 Pixel Visual Core、Pixel 4 上的迭代版 Pixel Neural Core , 以及贯穿始终的 Titan M 系列安全芯片 , 都是 Google 在涉足 SoC 芯片之前的尝试 , 到 Google Tensor 最终得以在 Pixel 6 系列上实际应用 , 这些原本都需要占用额外主板空间的协处理器 , 都能以一种更加高效的方式进一步整合进 SoC 之中 。

文章图片

图8/10

过去 , 在 Pixel 5 中加入‘环境光’功能之后 , Google 就已经在技术博客中吐槽‘让手机算力支持实现照片后期所需的算力 , 是一件很头疼的事’ , Google 不得不重新训练模型 , 让补光算法能在搭载高通骁龙 765G 的 Pixel 5 上正常使用 。

不只是算力不足 , 在 Google 开发团队眼中 , 现有 Pixel 手机一直使用的高通骁龙 SoC , 从架构到功能 , 都不足以满足 Pixel 各种 AI 应用场景的使用需求 ,可以说是‘积怨已久’ 。

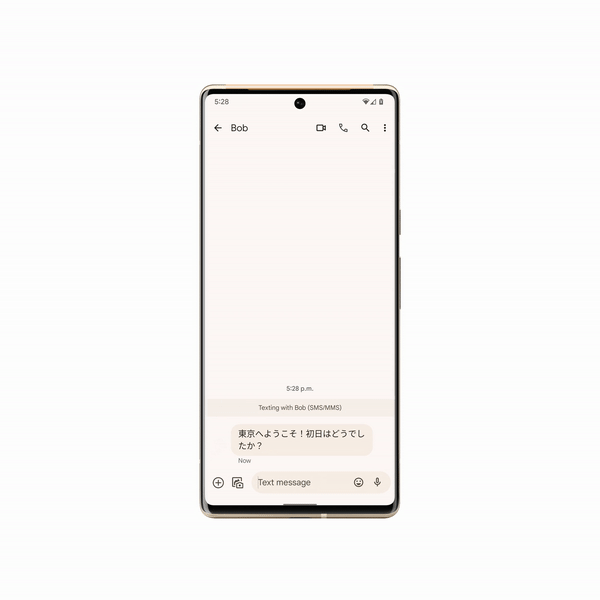

同理 , 随着量身定制的硬件提升 Pixel 6 上也加入了很多 AI 带来的效率提升:比如 Pixel 6 中识别准确率与速度都有大幅提升的离线语言转文字功能 , 就是 Google 借助机器学习 , 将已经构建完毕的语音识别模型预制在手机内存中 , 使用 Google Tensor 内建的 TPU 模组 , 实现比传统算力更加高效的识别效果 ;

实时翻译功能也不再局限于翻译 App 内 , 被整合进更多应用中 。

文章图片

图9/10

如今 , 随着计算摄影在更多手机厂商的尝试逐渐成熟 , 曾经困扰着 Google 的问题 , 也成为越来越多手机厂商的共识:为软件功能量身定制硬件 , 反过来进一步提升软件的运行效率 , 或许才是未来在手机端更现实的解决方案 。

推荐阅读

- Google|谷歌暂缓2021年12月更新推送 调查Pixel 6遇到的掉线断连问题

- 设备|雷军亲自演示 MIUI 13“小米妙享中心”:一拖流转媒体内容

- 相关|科大讯飞:虚拟人交互平台1.0在媒体等行业已形成标准产品和应用

- 媒体|贵阳“融媒大脑”平台发布

- Apple|韩国要求苹果和Google删除"玩游戏赚钱"的游戏类别

- the|流媒体大战白热化:明年美8大媒体集团内容开支将达1150亿美元

- 媒体播放器|内容付费来了 消息称抖音正测试短视频“赞赏”功能

- Google|Chrome被起诉侵犯隐私 加州允许原告当庭质问谷歌CEO

- 媒体播放器|内容审核人员因PTSD起诉TikTok 律师称其遭遇报复性停职惩罚

- Google|谷歌母公司Alphabet成2021年股价涨幅最大科技巨头 全年上涨68%