鹏城-百度·文心超强性能:60多项任务取得最好效果 , 大幅刷新小样本学习任务基准

鹏城-百度·文心究竟效果如何?目前 , 该模型已在机器阅读理解、文本分类、语义相似度计算等60多项任务中取得最好效果 。

在行业领域 , 仅利用少量标注数据甚至无需标注数据 , 就能解决新场景的任务已成为AI工业化大规模应用的关键 。 该模型在30余项小样本和零样本任务上均取得了最优成绩 , 能够实现各类AI应用场景效果的提升 , 也为产业化规模应用打开了新窗口 。

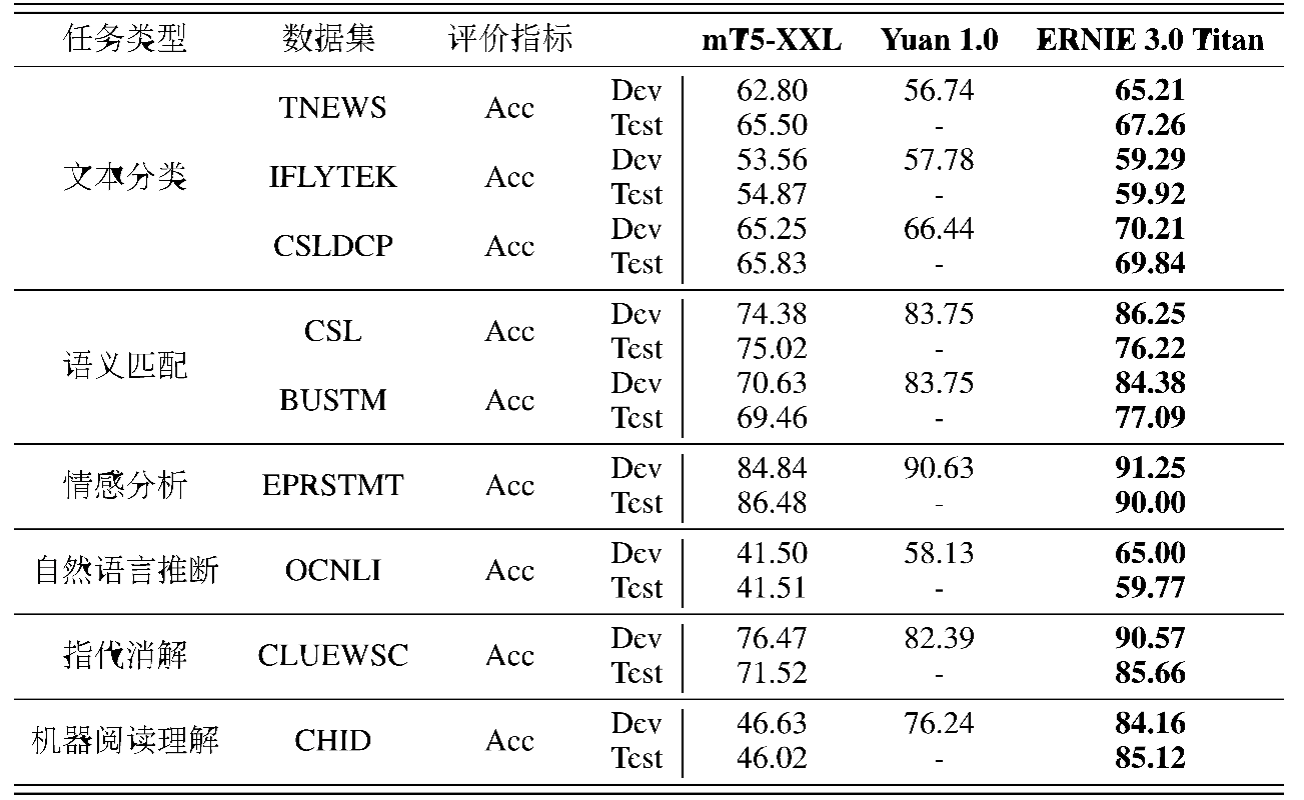

文章图片

鹏城-百度·文心小样本学习效果

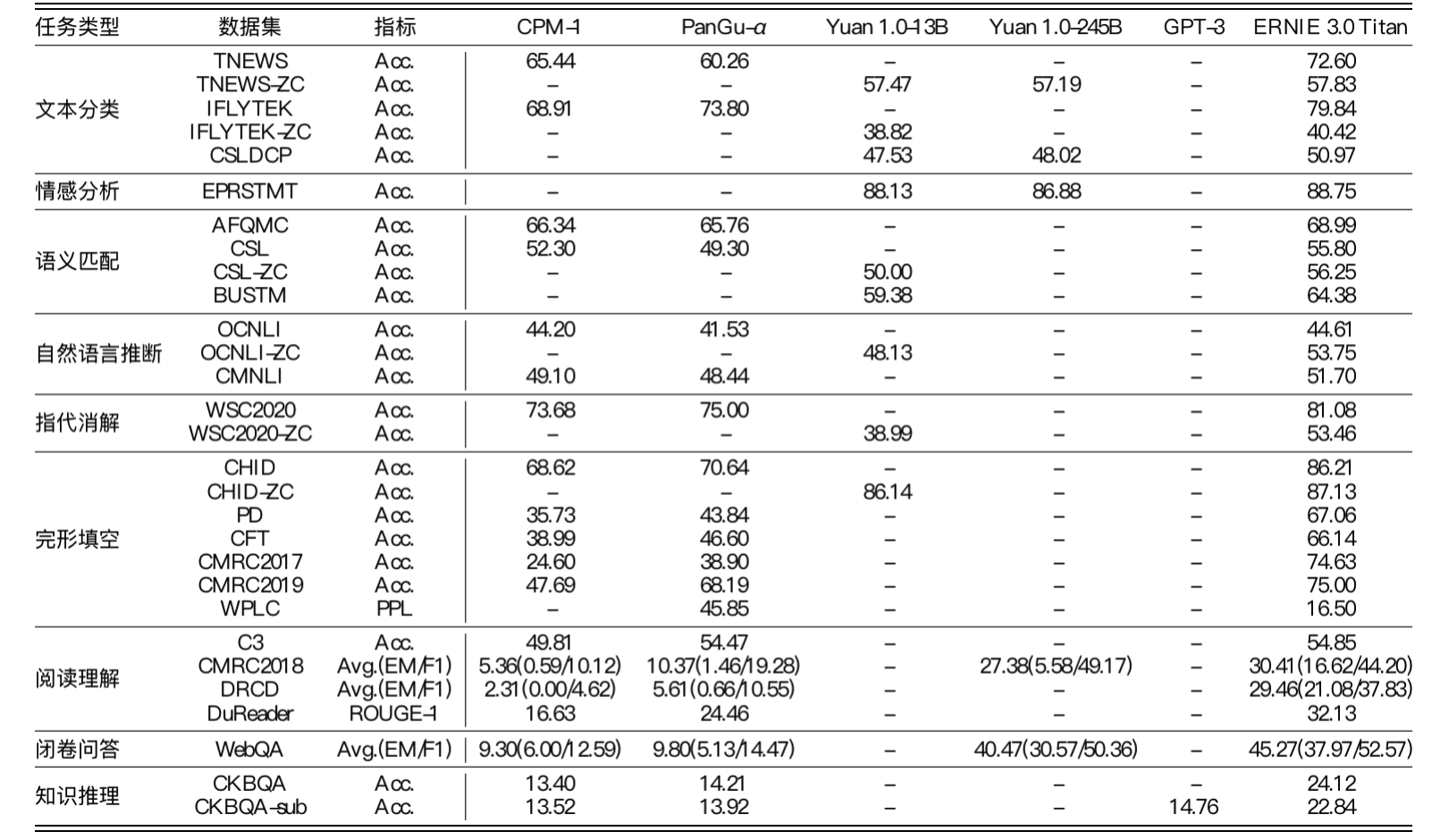

文章图片

鹏城-百度·文心零样本学习效果

解决应用落地难题:百度团队首创大模型在线蒸馏技术

大模型训练、推理所消耗的资源极其昂贵和密集 。 Paddle Serving已提供了超大模型的高速推理方案 , 但为了进一步打造大模型的绿色落地方案 , 降低大模型应用成本 , 研究团队提出了大模型在线蒸馏技术 。

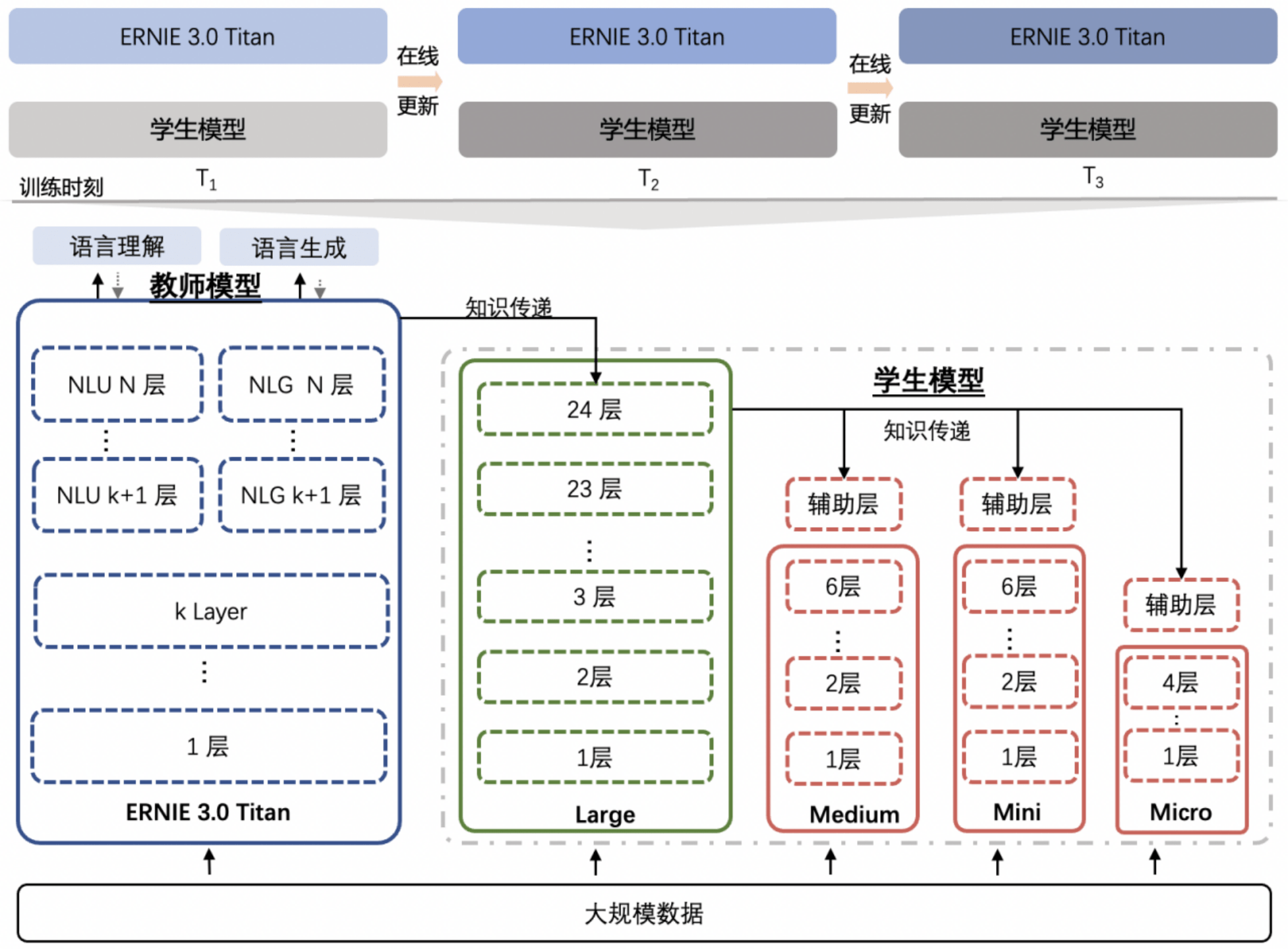

文章图片

在线蒸馏技术

具体来说 , 该技术在鹏城-百度·文心学习的过程中周期性地将知识信号传递给若干个学生模型同时训练 , 从而在蒸馏阶段一次性产出多种尺寸的学生模型 。 相对传统蒸馏技术 , 该技术极大节省了因大模型额外蒸馏计算以及多个学生的重复知识传递带来的算力消耗 。

这种新颖的蒸馏方式利用了鹏城-百度·文心规模优势 , 在蒸馏完成后保证了学生模型的效果和尺寸丰富性 , 方便不同性能需求的应用场景使用 。 此外 , 研究团队还发现 , 鹏城-百度·文心与学生模型尺寸差距千倍以上 , 模型蒸馏难度极大甚至失效 。 为此 , 研究团队引入了助教模型进行蒸馏的技术 , 利用助教作为知识传递的桥梁以缩短学生模型和鹏城-百度·文心表达空间相距过大的问题 , 从而促进蒸馏效率的提升 。

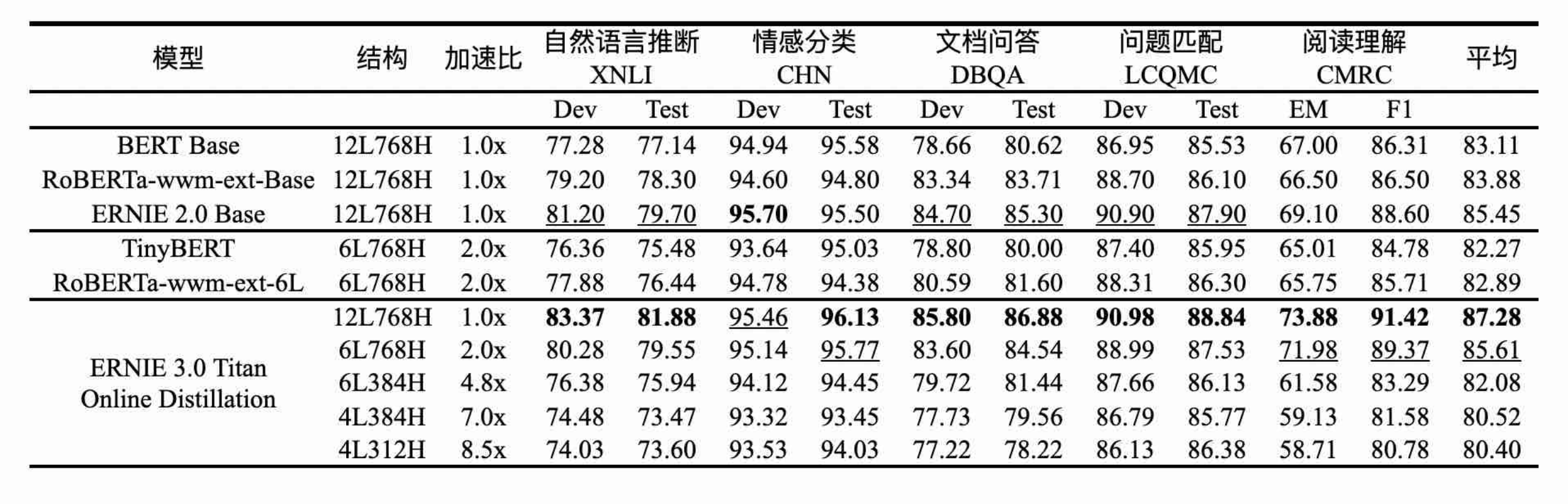

文章图片

鹏城-百度·文心压缩版模型效果

鹏城-百度·文心在线蒸馏方案的效果非常显著 , 模型参数压缩率可达99.98% 。 压缩版模型仅保留0.02%参数规模就能与原有模型效果相当 。 相比直接训练参数规模是自身2倍的BERT Base模型 , 鹏城-百度·文心在5项任务准确率上绝对提升了2.5% , 而相对于同等规模的RoBERTaBase , 准确率则绝对提升了3.4% , 验证了鹏城-百度·文心在线蒸馏方案的有效性 。

推荐阅读

- 最新消息|世界单体容量最大漂浮式光伏电站在德州并网发电

- 测试|图森未来完成全球首次无人驾驶重卡在公开道路的全无人化测试

- 选型|数据架构选型必读:2021上半年数据库产品技术解析

- ASUS|华硕预热ROG Flow Z13:称其是“全球最强悍的游戏平板”

- MateBook|深度解析:华为MateBook X Pro 2022的七大独家创新技术

- IT|全球汽车行业价值两年突增至3万亿美元 中国电动车企立大功

- IT|全球供应25亿剂疫苗 科兴上半年营收110亿美元

- IT|全球每日新增确诊病例首超100万例 世卫:两大毒株正掀起“疫情海啸”

- Tesla|特斯拉在美国召回约47.5万辆汽车 接近其去年全球交付总量

- 堆芯|全球首座,世界领跑!