机器之心报道

编辑:张倩

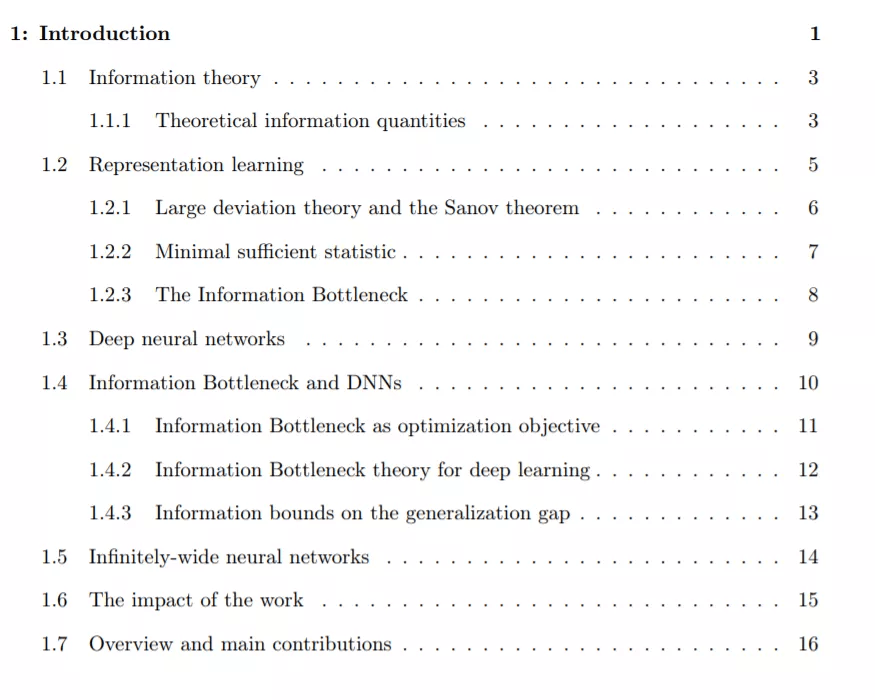

这篇博士论文在 Tishby 的指导下完成 , 汇集了师徒二人及其他合著者在深度学习 + 信息论领域的研究成果 , 非常值得一读 。深度学习的黑箱属性一直为人所诟病 , 很多研究者都在努力解决这一问题 。 其中 , 用信息论来提高深度神经网络的可解释性是一个非常有趣的方向 。

在这个方向上 , 「信息瓶颈」提出者、希伯来大学计算机科学教授 Naftali Tishby 及其学生的论文属于必读文献 。

2015 年 , Tishby 和他的学生 Noga Zaslavsky 发表了一篇论文 , 假设深度学习是一个信息瓶颈程序 , 尽可能地压缩数据噪声 , 保留数据想表达的信息 。 也就是说 , 神经网络就像把信息挤进瓶颈一样 , 只留下与一般概念最为相关的特征 , 去掉大量无关的噪音数据 。

2017 年 , Tishby 和他的另一个学生 Ravid Shwartz-Ziv 联合进行了一场引入注目的实验 , 揭示了发生在深度学习之中的挤压过程 , 表明深度神经网络在压缩状态中提高泛化能力 , 从而更加擅长标记测试数据 。 这篇论文就是大名鼎鼎的《 Opening the black box of Deep Neural Networks via Information 》 。 深度学习先驱 Geoffrey Hinton 在听了 Tishby 的报告之后给他发了邮件:「信息瓶颈极其有趣 , 我要再听一万遍才能真正理解它 , 当今能听到如此原创的想法非常难得 , 或许它就是解开谜题的那把钥匙 。 」纽约大学心理学和数据科学助理教授 Brenden Lake 也认为 , Tishby 的研究成果是「打开神经网络黑箱的重要一步」 。

文章图片

在这篇论文之后 , Tishby 及其学生继续在深度学习 + 信息论的方向上深入研究 。 但不幸的是 , Tishby 于去年 8 月份离世 , 剩下的问题只能交给后人来探索 。

在 Tishby 去世的这年 , Ravid Shwartz-Ziv 完成了他的博士论文 ——《 Information Flow in Deep Neural Networks 》 。

这篇论文在 Tishby 的指导下完成 , 汇集了师徒二人及其他合著者在深度学习 + 信息论领域的研究成果 , 非常值得一读 。

文章图片

最近 , Ravid Shwartz-Ziv 表示 , 他已经将该论文上传到了 arXiv 。

文章图片

文章图片

论文链接:https://arxiv.org/pdf/2202.06749.pdf

以下是论文的大致内容 。

Ravid Shwartz-Ziv 的博士论文

尽管深度神经网络已经取得了巨大的成功 , 但我们还没有一个全面的理论来解释这些网络如何工作或如何构造 。 深度网络通常被视为黑盒 , 我们无法清楚地解释它们的预测结果或可靠性 。 如今 , 了解深度神经网络的突破性性能是科学界面临的最大挑战之一 。 为了更有效地使用这些算法并改进它们 , 我们需要了解它们的动态行为(dynamic behavior)以及它们学习新表示的能力 。

在这篇博士论文中 , 作者应用了信息论中的原理和技术来解决上述问题 , 以提高我们的理论理解 , 并运用这一理解来设计更好的算法 。

文章图片

论文的主要成果和贡献可以分为三个部分 , 具体如下:

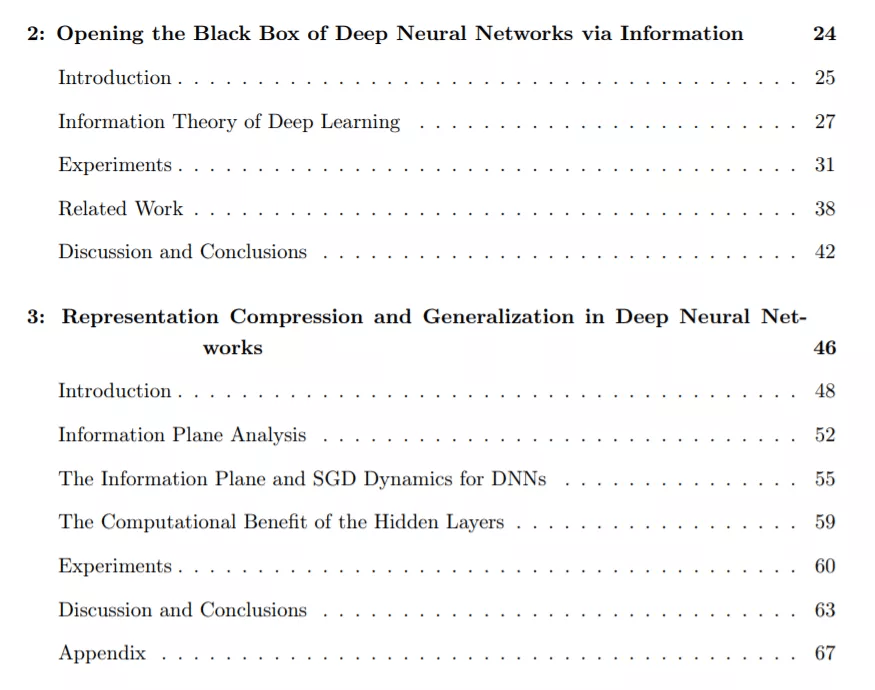

第二章和第三章介绍了作者针对深度学习模型提出的信息论方法 。

作为对深度学习系统的解释 , 作者提出使用信息瓶颈(IB)理论 。 这种分析网络的新范式揭示了它们的分层结构、泛化能力和学习动态 。 基于这一分析 , 作者发现深度网络优化了每一层关于输入和输出变量的互信息 , 导致每一层都要在压缩和预测之间做出权衡 。 作者对这些网络的分析和数值研究表明 , 随机梯度下降算法遵循 IB 权衡原则 , 分两个阶段工作:快速经验误差最小化阶段和慢速表示压缩阶段 。 这些阶段通过每层不同的信噪比(SNR)来区分 。

此外 , 他们证明了 SGD 由于压缩阶段而达到了这个最优界限 , 并在表示压缩上导出了一个新的高斯界限 , 同时将其与压缩时间联系起来 。 他们的结果还表明 , 网络的层收敛到 IB 理论界限 , 导致编码器和解码器分布之间的自洽关系 。

文章图片

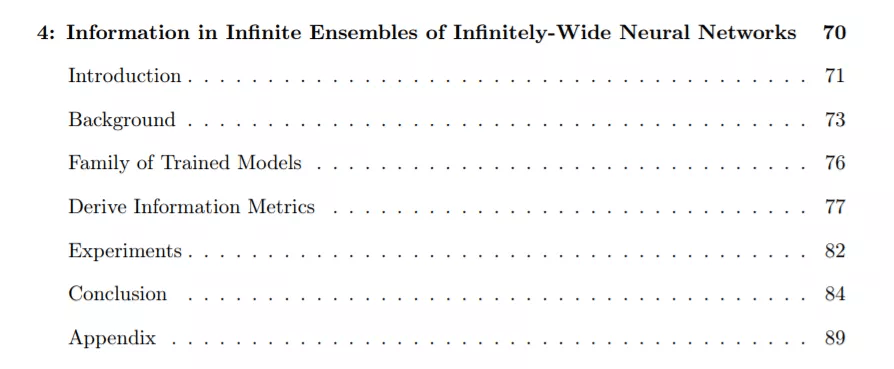

第四章讨论了将 IB 应用于深度神经网络时最困难的问题之一 —— 估计高维空间中的互信息 。

尽管互信息在数据科学中是一个重要的量 , 但它在计算方面一直很有挑战性 。 互信息的计算只适用于离散变量或已知概率分布的有限数量的问题 。 为了更好地估计信息论数量(information-theoretic quantities)并研究泛化信号 , 作者研究了几个框架 , 并利用了最近的理论研究成果 , 如神经正切核(NTK)框架 。

在研究中 , 他们发现 , 对于无限宽的神经网络的无限集合 , 他们可以获得许多信息论数量及其边界的易处理的计算 。 许多量可以通过网络的核(kernel)以封闭形式的解来描述 。 通过分析这些内容 , 我们可以了解网络的重要信息论数量 , 以及压缩、泛化和样本大小之间的关系 。

文章图片

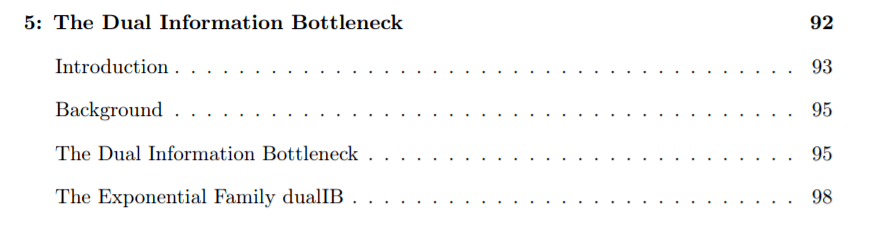

第五章介绍了一个新的信息论框架 —— 双重信息瓶颈(dualIB) 。

尽管 IB 框架有很多优点 , 但它也有几个缺点:IB 是完全非参数化的 , 并且只在概率空间上运行 。 此外 , IB 公式不涉及预测未见模式的任务 , 并假定能够完全获取联合概率 。 因此 , 作者开发了 dualIB , 它仅通过在失真函数中的项之间进行切换来解决 IB 的一些缺点 。 dualIB 可以解释数据的已知特征 , 并使用它们对未知的例子做出更好的预测 。 作者提供了 dualIB 自洽方程 , 该方程允许他们获得解析解 。 局部稳定性分析揭示了解的临界点的潜在结构 , 产生了最佳模式表示的完整分叉图 。

他们发现了 dualIB 目标的几个有趣的性质 。 首先 , 当以参数化形式表达时 , dualIB 保留其结构 。 它还优化了平均预测误差指数 , 从而提高了关于样本大小的预测精度 。 除了 dualIB 的解析解 , 他们还提供了一个变分 dualIB 框架 , 该框架使用深度神经网络来优化泛函 。 该框架实现了真实世界数据集的 dualIB 的实现 。 通过它 , 作者对其动态变化进行了实验评估 , 并验证了现代深度神经网络的理论预测 。

文章图片

文章图片

总之 , 该论文提出了一个新的信息论视角来研究深度神经网络 , 它利用了深度学习和 IB 框架之间的对应关系 。 这一独特的视角可以提供许多好处 , 比如对深度神经网络有更深入的理解 , 解释它们的行为 , 并改善它们的性能 。 同时 , 他们的研究也开拓了新的理论和实践研究问题 。

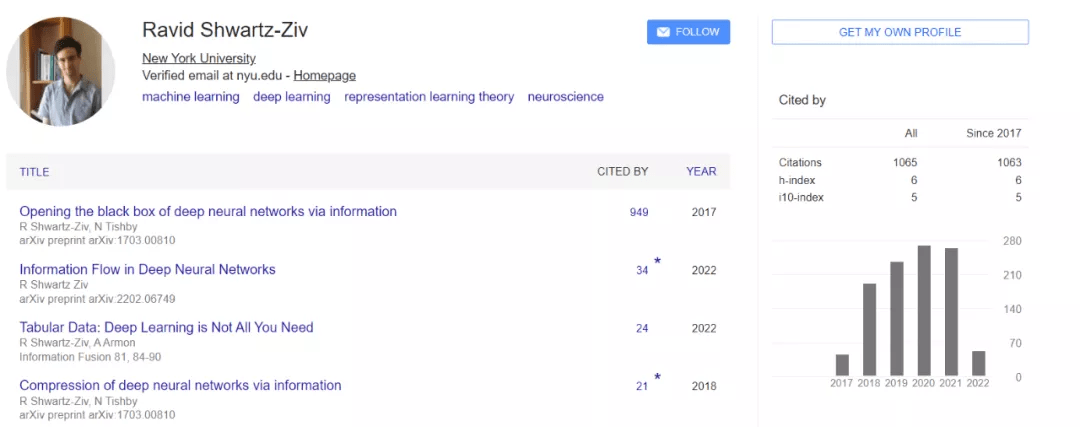

Ravid Shwartz-Ziv 简介

Ravid Shwartz-Ziv 是希伯来大学计算机科学与神经科学博士 , 读博期间专注于深度神经网络与信息论之间的联系 , 试图基于信息论对 DNN 进行更深入的理解 , 并将其应用于大规模的问题 。 2018 年 , 他拿到了谷歌博士生奖研金 。

2021 年 , Shwartz-Ziv 博士毕业并进入纽约大学数据科学中心担任 CDS Faculty Fellow , 与 Andrew Gordon Wilson、Yann Lecun 等人一起研究贝叶斯深度网络、信息论和自监督学习 。

文章图片

【Tishby|信息瓶颈提出者生前指导,129页博士论文神经网络中的信息流公布】Google Scholar 主页:https://scholar.google.co.il/citations?user=SqsLFwMAAAAJ&hl=en

推荐阅读

- 信息|华为虚拟资源共享专利公布,方便虚拟资源分配转让

- 最新消息|已在调研阶段?蔚来回应进军手机行业:目前没有可供披露信息

- 建设|中科信息:可为组织客户提供数据中心建设整体解决方案

- 方面|蔚来回应进军手机行业:目前没有可供披露的信息

- 灾害事故|以信息化推进应急管理 我国将构建“智慧应急大脑”

- 人物|马斯克指控SEC:故意泄露调查信息对他实施报复

- 人物|马斯克指责SEC泄露调查信息,对其进行报复

- 信息|吃个饭隐私就没了?手机扫码点餐背后的隐忧和猫腻你有了解没?

- 电子|电子信息工程科技发展 面临“十三大挑战”

- 手机|警惕!这样手机截图会暴露个人信息