微软|OpenAI 是如何被10亿美元收买了“非盈利”灵魂的?( 三 )

文章插图

除了传播假新闻,GPT-3 的另一个危害是传播人类无法区分的假新闻。这一点也被 OpenAI 在“Language Models are Few-Shot Learners”一文中认可、甚至强调了:

“[M]ean human accuracy at detecting the longer articles that were produced by GPT-3 175B was barely above chance at 52%. This indicates that, for news articles that are around 500 words long, GPT-3 continues to produce articles that humans find difficult to distinguish from human written news articles.”

(人类在检测 GPT-3 175B 生成的较长文章时的平均准确率仅略高于 52%。这表明,GPT-3 能够继续生成人类难以区分的、长度约为 500 字的新闻文章。)

Codex and Copilot,侵权了吗?

今年他们也做了类似的事情。

几周前,OpenAI、GitHub和微软联合发布了一款编程工具 Copilot,这款工具基于GitHub及其他网站的源代码,可根据上文提示为程序员自动编写下文代码!被称为是结对编程的虚拟版本。

结对编程是一种常见的敏捷软件开发技术——即两个开发人员在同一个项目上并肩协作,轮流编写代码并检查合作伙伴的输出。

抛开可能对开发者造成的潜在威胁不谈,这款工具仅发布几天后便遭到了猛烈的抨击,原因是它在未经许可的情况下,使用了公共的Github存储库的开源代码。

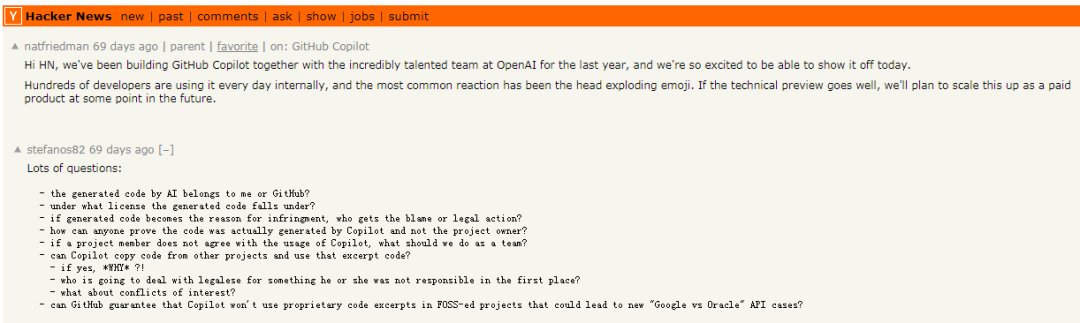

当时,GitHub的首席执行官 Nat Friedman 公布这则消息后,Hacker news上已经有不少网友在讨论,Copilot可能会存在潜在的法律风险。

文章插图

比如,一位网友就指出了多个疑问:

AI生成的代码属于我?还是GitHub?

生成的代码属于哪个许可证?

如果生成的代码侵权,谁来承担法律责任?

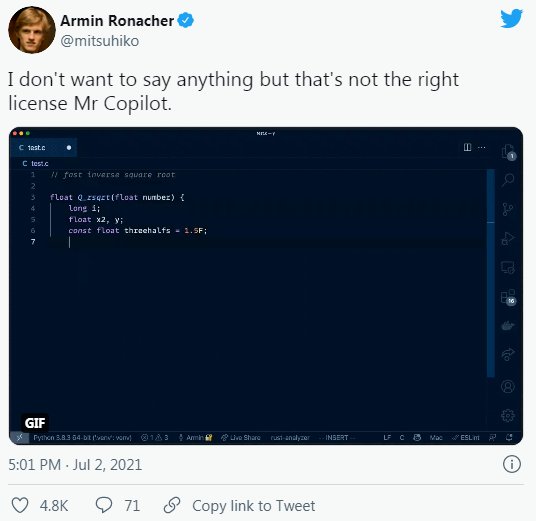

一位从事开源工作的开发者 Armin Ronacher 直接在 Twitter 上分享了一个示例,表明 Copilot确实存在剽窃版权代码的可能。

文章插图

下面也有一位网友评论说:“我们也发现Copilot 直接复制了一段GPL代码,这说明它在商业使用上是有风险的。

其实,就算Copilot没有逐字复制代码,也会产生一个道德问题:GitHub 或者 OpenAI 等公司是否有权使用数千名开发者的开源代码对自己的系统进行训练,并将这些系统的使用权卖给开发者自己?

一位开发者兼游戏设计师 Evelyn Woods 对此评论说:“他们好像在把开源当成一个笑话!”

Alberto 发出疑问:

难道他们已经与微软的利益捆绑在一起,以至于忘记了最初“造福人类”的宗旨?还是他们真的以为自己拥有最好的工具和人才可以独自开拓这条道路,这是否意味着OpenAI出卖了自己的灵魂?他们是按照自己的意愿来建设未来,还是考虑到了更多人?更重要的是,他们是否想从中获取巨额利润?

OpenAI 在迈向更复杂人工智能的道路上占据了主导地位,当然,也有许多其他有潜力的机构在做相关的工作,这些机构并没有与金钱产生直接的联系,因而也受到了外界广泛的关注。

就目前来看,大型科技公司的目标似乎是并不是建立一个满足科学好奇心的通用人工智能,也不是建立一个最安全、最负责、最道德的人工智能。他们的首要任务是赚钱!

当然,这本身并不违法,但在道德上需要警惕,因为他们可能会不惜一切手段去实现目标,而这个过程可能会对大多数人产生不利影响。

推荐阅读

- 阿里巴巴|马云“接班人”是啥来头第一天上任,阿里巴巴损失517亿!

- 黑客|最担心的事还是发生了 19岁黑客远程破解逾25台特斯拉

- 电商|俞敏洪或要“转型”?在电商平台做起直播带货,是有何打算?

- 工地|“小马云”已不火,如今“工地马云”火了,网友:确定不是本人?

- 猫腻|拼多多的商品这么便宜,都是山寨、假货吗?看完才发现其中猫腻!

- 阿里巴巴|曾是阿里高管,遭马云“忽视”创办410亿公司,却进腾讯口袋

- 产品|又一行业曝光,90%是假货,曾被央视“点名”,你还在购买吗?

- focus seller|销量增涨1500%!GMV翻3倍!是谁在加速中国跨境商家出海变现?

- 马化腾|刷屏!马化腾:腾讯只是一家普通公司,随时可以被替换

- 价格战|快递集体"春节不打烊",究竟是反内卷还是内卷加剧?