财经自媒体|面对自动驾驶这匹野马,雷达系与视觉系谁才是套马杆的汉子

这是造福人类的伊甸园还是危害人间的潘多拉魔盒?

文/渣渣辉

来源:科创实验室(ID:scilabs)

机器不会犯错 , 除非机器设计缺陷或接收到的指令本身就是错误的 。

1916年索姆河战役爆发 , 双方在法国索姆河地区展开百万规模的阵地战 , 英法联军为了一举击溃德军将“坦克”这一新式武器秘密运往前线并投入战场 。 不过由于产品设计缺陷与士兵操作失当 , 首批运到前线的49辆坦克实际投入到战场的仅有18辆 , 其中9辆还被陷在战壕中无法冲击阵地 。

而近年来同样作为新物种的自动驾驶也遇到了彼时坦克的境遇——掉链子 。 在国际上 , 智能汽车巨头特斯拉自推出辅助自动驾驶功能后 , 在全球范围内已发生数百起交通事故 , 累计造成175人死亡 , 其中有200起事故是由产品设计缺陷从而造成车辆失控造成的 , 当然人为操作不当也占有不少的比重 。

而在国内 , 近期造车新势力蔚来也爆发了安全事故 。 上周六 , “美一好”公众号发布的讣告 , 称:“8月12日下午2时 , 上善若水投资管理公司创始人、意统天下餐饮管理公司创始人、美一好品牌管理公司创始人林文钦(萌剑客) , 驾驶蔚来ES8汽车启用自动驾驶功能(NOP领航状态)后 , 在沈海高速涵江段发生交通事故 , 不幸逝世 。 ”

一石激起千层浪 , 此次事故也将蔚来与自动驾驶推上风口浪尖 , 不少人认为此次事故与蔚来此前对辅助驾驶夸大宣传有关 。 对此蔚来汽车相关工作人对《每日经济新闻》表示:“目前 , 事故还在进一步调查中 , (我们)暂时不做过多回应 。 ”不过《证券时报》消息称:“蔚来汽车品牌部人士回复表示 , Navigate on Pilot(NOP)领航辅助不是自动驾驶 , 后续有调查结果会向外界同步信息 。 ”

不过在事故等喧嚣之外仍有不同声音 。 “我觉得随着时间推移 , 人们会越来越习惯或者越来越认识到自动驾驶 , 其实比人类的这一种驾驶更安全一些 。 ”李彦宏在中国发展高层论坛中谈到自动驾驶时说道 。

那么问题来了 , 自动驾驶究竟是造福人类的伊甸园还是危害人间的潘多拉魔盒?人类如何才能驯服自动驾驶这匹野马?

01

自动驾驶是如何工作的?

自动驾驶是一个较为新兴的技术与概念 。 1999年 , 美国卡耐基梅隆大学研制的无人驾驶汽车Naclab-V完成了第一次无人驾驶试验 , 自动驾驶自此进入了人类的世界 。 不过真正让自动驾驶(辅助驾驶)概念走向大众的还是十多年后的特斯拉 。

自动驾驶共有6个级别 , L0级是完全由驾驶员进行驾驶操作;L1级别是指特定情况下汽车能辅助驾驶员完成某些驾驶任务;L2级别的自动驾驶能完成某些驾驶任务 , 但驾驶员需要时刻监视周围环境的变化 , 遇到危险情况随时准备接管;到了L3级别 , 驾驶员几乎不用时刻准备接管 , 汽车可以独立完成全部动作;L4和L5级别是完全自动驾驶技术 , 汽车已经完全不用驾驶员的操控 , 不过L4级别只有在高速公路等特定条件下才可完全独立 , 而L5级别则在任何条件下都成立 , 包括暴雨、业务、大雾、大雪等复杂环境 。

目前虽然自动驾驶技术仍处于早期探索阶段 , 但专家们普遍认为自动驾驶汽车有五个核心部件:计算机视觉、传感器融合、地方化、路径规划、控制 。

文章图片

图1/5

图片来源:Forbes

计算机视觉是我们如何使用摄像头来观察道路 。 人类通过处理一辆基本上只有两只眼睛和一只大脑的汽车来展示视觉的力量 。 对于自动驾驶汽车 , 我们可以使用相机图像查找车道线 , 或跟踪路上的其他车辆 。

传感器融合是我们如何整合来自其他传感器(如雷达和激光)的数据以及相机数据 , 以全面了解车辆的环境 。 相对于光学相机 , 有某些测量如距离或速度传感器更擅长 , 并且传感器也可以在恶劣天气下更好地工作 。 通过结合我们所有的传感器数据 , 车辆可以更深入地了解周边环境 。

本地化是我们如何弄清楚我们在世界上的位置 , 这是我们了解世界是什么样子之后的下一步 。 我们都有带GPS的手机 , 所以看起来我们已经知道我们在哪里了 。 但事实上 , GPS只精确到1至2米以内 。 想想1-2米有多大!如果一辆车出了问题1到2米 , 它可能会在人行道上撞东西 。 因此 , 我们有更复杂的数学算法 , 帮助车辆本地化到1~2厘米以内 。

【财经自媒体|面对自动驾驶这匹野马,雷达系与视觉系谁才是套马杆的汉子】路径规划是下一步 , 一旦我们知道世界是什么样子 , 我们在哪里 。 在路径规划阶段 , 我们绘制了穿越世界的轨迹 , 以达到我们想要去的地方 。 首先 , 我们预测我们周围的其他车辆将做什么 。 然后 , 我们决定要采取哪种策略来应对这些车辆 。 最后 , 我们构建一个轨迹或路径 , 以安全舒适地执行该操作 , 既算法 。

控制是自动驾驶周期中的最后一步 , 在确定路径规划块的轨迹后 , 车辆需要达到目的地则需要通过程序控制转动方向盘、油门和制动器 , 才能实现自动驾驶 , 就像仙侠剧中需要口念功法才能实现御剑飞行一样 。

02

自动驾驶怎样驾驶?

目前 , 自动驾驶主要有两条实现路径 , 其一是以谷歌、华为、蔚来为代表的雷达派 , 虽然也有用到光学摄像头辅助收集驾驶信息 , 但核心仍然是靠雷达充当汽车的眼睛;其二是以特斯拉为代表的视觉系 , 他们车上也有安装包括雷达在内的传感器 , 可依靠360度的光学相机像人类双眼一样去感知周围的环境才是其灵魂 , 那么雷达派与视觉系谁更适合自动驾驶?

(一)雷达派

在讲雷达之前可以先了解一下其近亲声纳 , 最初的深度感应机器人是卑微的蝙蝠(5000万年前!蝙蝠(或海豚等)能够执行一些相同的功能 , 激光雷达使用回声定位 , 也被称为声纳(声音导航和测距) 。 声纳不是测量激光雷达等光束 , 而是使用声波测量距离 。

经过5000万年的生物排他性 , 第一次世界大战推进了首次大规模部署人造声纳传感器的时间表 , 潜艇战争的到来 。 声纳在水中效果优异 , 声音比光或无线电波传播得好得多(一秒钟内更多) 。 声纳传感器目前主要以停车传感器的形式在汽车上使用 。 这些短程(+5米)传感器使一个廉价的方式知道这堵墙离你的车有多远 。 声纳尚未被证明适用于自动驾驶汽车需求(60m+)的种类 。

雷达(无线电方向和测距) , 很像声纳 , 是另一种技术发展在臭名昭著的世界大战(WW2 , 这一次) 。 它不是使用光或声波 , 而是利用无线电波来测量距离 , 这是一种久经考验的方法 , 可以精确检测和跟踪远至200米远的物体 。

文章图片

图2/5

图片来源:Forbes

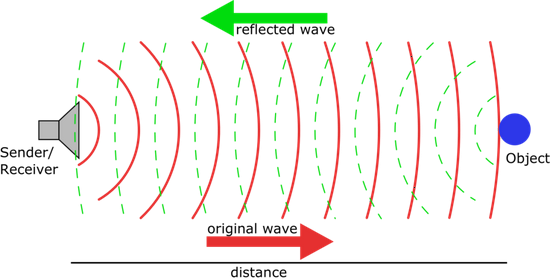

从市场来看 , 用于自动驾驶领域的雷达主要有两类 , 一类是毫米波雷达 , 即工作频段在毫米波频段的雷达(车载雷达频率一般在76-81GHz) , 测距原理跟一般雷达一样 , 也就是把无线电波(雷达波)发出去 , 然后接收回波 , 根据收发之间的时间差测得目标的位置数据 。

文章图片

图3/5

图片来源:Forbes

另一类是激光雷达 , 主要是通过发射激光束 , 来探测目标的位置、速度等特征量 。 车载激光雷达普遍采用多个激光发射器和接收器 , 建立三维点云图 , 激光发射器线束的越多 , 每秒采集的云点就越多 , 探测性能也就更强 , 通过生成巨大的3D 地图从而达到实时环境感知的目的 , 甚至可提前知道车道的界限 , 或者前面 500 米处有停车标志或红绿灯 , 也能识别骑自行车的人或步行的人是以什么速度和方向前进 。

文章图片

图4/5

图片来源:Forbes

然而激光雷达却始终被价格所困扰 , 线束越多也就代表着激光雷达的造价就更加昂贵 , 64线束的激光雷达价格是16线束的10倍 , 例如百度和谷歌无人驾驶汽车车身上的64位激光雷达 , 售价就高达70万元人民币在 , 这也是为什么目前使用激光雷达的智能汽车少的原因 。

(二)视觉系

说完雷达派再来看看视觉系 。

与其说是视觉系 , 到不如说特斯拉 , 因为目前坚持依靠单纯的光学相机、类人视觉实现自动驾驶的也就特斯拉了 。 其创始人埃隆·马斯克(Elon Musk)在社交平台、年会上表示:“车辆上的雷达方案是极其愚蠢的 , 任何使用激光雷达方案的人或者企业最后都将失败 , 他们大费周章的使用这些昂贵的传感器本身就是一个麻烦 。 ”

特斯拉利用8个摄像头来识别现实世界中的物体(野范围360 度 , 监测距离最远可达 250 米) , 摄像头获取的图像包括行人、其他车辆、动物或障碍物 , 同时毫米波雷达、超声波雷达以及惯性测量单元记录下当前车辆所处的环境数据 , 并将数据发送给特斯拉的自动驾驶电脑 。 自动驾驶电脑在进行算法的计算之后 , 将速度和方向信息传递给转向舵以及加速、制动踏板 , 实现对车辆的控制 。

不过普通单目与双目摄像头所捕捉的内容都是二维图像 , 缺乏深度信息 , 所以无法判断物体的远近 。 对此 , 特斯拉还安装了一颗前视三目摄像头 , 通过车载处理器比较两个摄像头图像的差异判断物体的远近 , 然后再对输入图像进行感知、分割、检测、跟踪等操作 , 而这就要用到视觉系真正的杀手锏——自动驾驶算法了 。

文章图片

图5/5

三目摄像头 素材源于网络

特斯拉有专门的深度学习神经网络HydraNet , HydraNet包含48个不同的神经网络 , 通过这48个神经网络 , 就能输出1000个不同的预测张量 。 理论上来说 , 特斯拉的这个超级网络 , 能同时检测1000种物体 。 值得注意的是 , 特斯拉通过算法还可以预测流媒体视频中每一个像素的深度信息 , 这意味着只要算法够先进、算力够强 , 视觉传感器所捕捉的深度信息甚至可以超过激光雷达 。

但是光学摄像头对环境的宽容度并不高 , 在大雾、雨雪、沙包等恶劣环境下其能够捕获的信息即少又不准确 , 相较于激光雷达全天候的特征来说 , 视觉派目前是处于劣势的 , 并且激光雷达的价格也在降低 , 驯服自动驾驶这匹野马或许激光雷达才是套马杆的汉子 。

推荐阅读

- 测试|北京:自动驾驶测试里程突破365万公里

- 华依|中信证券:惯性导航有望成为L3及以上自动驾驶的标配产品

- 爆发|中信证券:自动驾驶渐行渐近,惯性导航刚需爆发

- 孙自法|中国科技馆“智能”展厅携多款机器人亮相 喜迎新年和人机共融时代

- 设备|雷军亲自演示 MIUI 13“小米妙享中心”:一拖流转媒体内容

- Siamese|一个框架统一Siamese自监督学习,清华、商汤提出简洁、有效梯度形式,

- 相关|科大讯飞:虚拟人交互平台1.0在媒体等行业已形成标准产品和应用

- 网站|无法使用?版本号是三位数的Chrome自带“bug”

- 媒体|贵阳“融媒大脑”平台发布

- 疫苗|国内首个自主研发四价流脑疫苗正式获批