双目立体视觉是机器视觉的一种重要形式 , 与人眼类似 , 它是基于视差原理 , 通过计算图像对应点间的位置偏差 , 来获取物体三维几何信息的方法 , 和基于TOF、结构光原理的深度相机不同 , 它不对外主动投射光源 , 完全依靠拍摄的两张图片(彩色RGB或者灰度图)来计算深度 。

传统的双目立体匹配算法针对弱纹理、反光等区域效果比较差 , 同时对于物体语义信息利用比较少 , 算法适用范围具有局限性 , 点云效果上限比较明显 。 随着深度学习技术的发展 , 基于CNN、Cost Volume、Transformer的立体匹配算法展现出来了极强的算法效果和潜力 。 目前知名自动驾驶数据集KITTI上的立体匹配任务排名靠前的基本都是基于深度学习的算法 。 基于深度学习的双目立体匹配算法对于计算芯片的AI算力提出了比较高的要求 , 对于研发模式也提出了新的要求 , 需要从传统的双目相机研发模式变成以AI为核心、软硬结合、数据驱动的研发模式 。

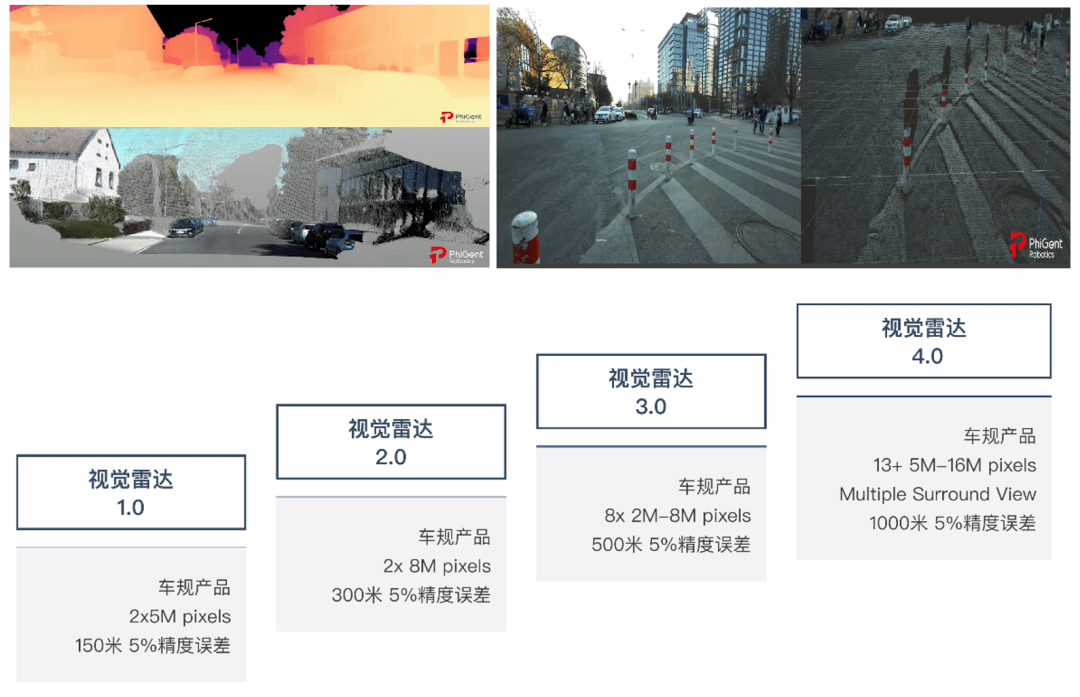

从双目立体视觉更进一步 , 充分利用相机的运动信息和多个相机间的几何约束 , 通过相机姿态估计、深度估计、光流估计、MVS等算法 , 以及任务之间互相监督的一系列自监督算法 , 可以得到360度的点云数据 , 也就是视觉雷达 , 从而形成与图像分辨率相匹配的稠密点云 。 同时 , 以摄像头+算力+算法为核心的视觉雷达 , 还具有产业链成熟可控、成本可控、器件稳定性有保证、满足车规等优势 , 更容易实现大规模前装量产上车使用 。

文章图片

图2:鉴智机器人视觉雷达Roadmap

2自动驾驶的大脑:全流程数据驱动的强单车智能

自动驾驶的大脑负责从感知到决策的驾驶全流程 , 也是自动驾驶最复杂、最核心和难度最高的部分 。 传统的以规则为核心的软件1.0工程化系统 , 在可维护性、扩展性和进化性上都具有一定的局限性 。 以AI和软件2.0为核心 , 全流程数据驱动的感知、预测、规控算法和强单车智能的解决方案 , 无疑是实现大规模无人驾驶更可行的方案 。

鉴智机器人核心团队在AI算法和应用、软件2.0的基础设施、数据驱动的大规模实践上拥有丰富的经验 , 将通过全流程数据驱动的自动驾驶大脑 , 建立强单车智能 , 从而降低对外部基础设施的依赖 , 更加利于自动驾驶的复制与推广 。

2.1 深度学习带来的2D感知技术突破

感知是自动驾驶获取信息的第一步, 所谓感知是指通过摄像头或其他传感器识别所看到的物体并理解该物体是什么 , 这对自动驾驶是至关重要的环节 。 自动驾驶车辆首先是要识别车道线 , 然后还要识别红绿灯、标志牌 , 除此之外就是识别障碍物比如前后左右有没有车辆 , 有没有行人 , 才能够进一步规划行驶路线 。

推荐阅读

- 影像|iQOO 9 系列预热:首发三星 GN5 传感器,150° 鱼眼超广角

- 智能化|龙净环保:智能型物料气力输送系统的研究及应用成果通过鉴定

- 手表|采用美信光学传感器,豪鹏科技电池,GARMIN佳明VENU2手表拆解报告

- 单孔|荣耀 Magic V 折叠屏手机通过 3C 认证,确认支持 66W 快充

- 视觉|超高色准打破行业天花板,创维S82还原真实世界

- 产品|数梦工场通过CMMI V2.0 L5评估,再获全球软件领域最高级别认证加冕

- Apple|新专利显示 苹果计划用光学传感器取代手表的数码表冠

- 无人驾驶飞机|跑道下埋5万多个传感器、无人车导航

- 大脑|ALS患者首次通过脑机接口发推

- 无人驾驶飞机|跑道下埋5万多个传感器、无人车导航——鄂州花湖机场有多“智慧”?