定义|时间走向二维,基于文本的视频时间定位新方法兼顾速度与精度( 四 )

文章图片

图 3 三种不同二维特征图时间开销的对比 。 N 表示多少个单元片段(clip)

文章图片

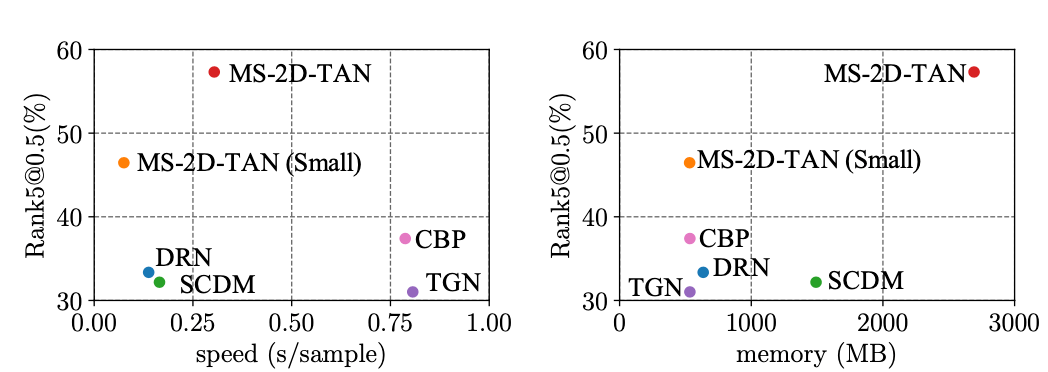

图 4 与其他方法的时间和内存开销对比

结语

本文针对基于文本的视频时间定位提出了一种全新的多尺度二维时间表示方式并提出了一种新的多尺度时域邻近网络(MS-2D-TAN) 。 该模型可以很好的利用邻近时域的上下文信息 , 并学出有区分性的视频片段特征 。 该研究的模型设计简单 , 也同时在三个数据集上取得了有竞争力的结果 。

参考文献:

[1] Songyang Zhang, Houwen Peng, Jianlong Fu, Jiebo Luo, “Learning 2D Temporal Adjacent Networks for Moment Localization with Natural Language”, AAAI 2020

[2] Jiyang Gao, Chen Sun, Zhenheng Yang and Ram Nevatia, “TALL: Temporal activity localization via language query”, ICCV2017

[3] Ranjay Krishna, Kenji Hata, Frederic Ren, Li Fei-Fei, and Juan Carlos Niebles, “Dense-Captioning Events in Videos”, ICCV 2017

【定义|时间走向二维,基于文本的视频时间定位新方法兼顾速度与精度】[4] Michaela Regneri, Marcus Rohrbach, Dominikus Wetzel, Stefan Thater, and Bernt Schiele, and Manfred Pinkal, “Grounding action descriptions in videos”, TACL 2013

推荐阅读

- 时间|Alphabet量子公司横空出世!Sandbox将与谷歌、DeepMind成姊妹

- 时间|天津战“疫”:逆境中的光芒

- 新浪科技|无法知道时间的情况下,在岩洞连续生活40天是种怎样的体验?

- 硬件|全志科技:12nm CPU相关产品正处在研发阶段 目前暂无详细时间表

- 重载|「以高质量论英雄」先进轨道交通装备产业链 引领大同制造走向世界

- 时间|折叠屏“一部到位”,荣耀已完成“基因重组”

- Google|谷歌大力游说欧盟 防止《数字市场法案》严重冲击业务

- 新浪数码|海信发布8K AI画质芯片:100%自主研发未来产品自己定义

- 社交|在新冠病例激增的情况下,Meta再次推迟重返办公室的时间

- 手机|荣耀Magic V重新定义折叠屏:首先是一部好用的主力机