基于对比的方法引入了互信息最大化的概念 , 通过预测两个视角(view)之间的相容性来进行自监督学习 。 本文从三个角度对该类方法进行整理 , 分别是:1)图增广方式;2)图对比学习代理任务;3)互信息估计方式 。

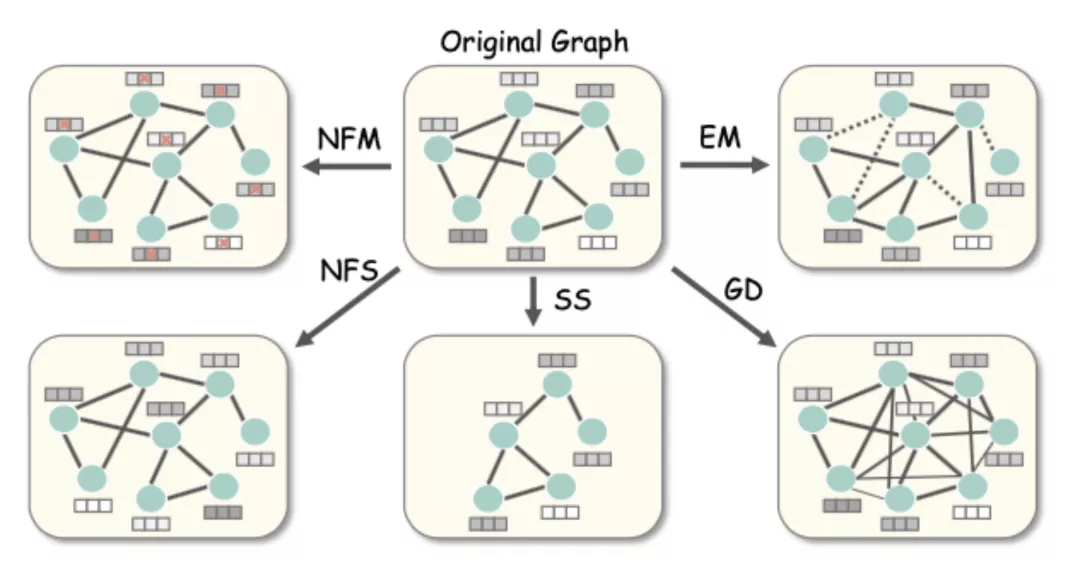

图增广技术用于从原始数据生成出增广数据 , 从而构成对比学习中不同的视角 。 图增广方法有特征增广、结构增广、混合增广 。 特征增广主要对图数据中的特征信息进行变换 , 最常见的手段是节点特征遮盖(NFM) , 即随机的将图中的一些特征量置为 0;此外 , 节点特征乱序(NFS)也是一种特征增广方法 , 其手段为对调不同节点的特征向量 。 结构增广的手段是对图结构信息进行变换 , 常见的结构增广为边修改(EM) , 包括对边的增加和删除;另一种结构增广为图弥散(Graph diffusion , GD) , 其对不同阶的邻接矩阵进行加权求和 , 从而获取更全局的结构信息 。 混合增广则结合了上述两种增广形式 , 一个典型的手段为子图采样(SS) , 即从原图数据中采样子结构成为增广样本 。

文章图片

图增广方法

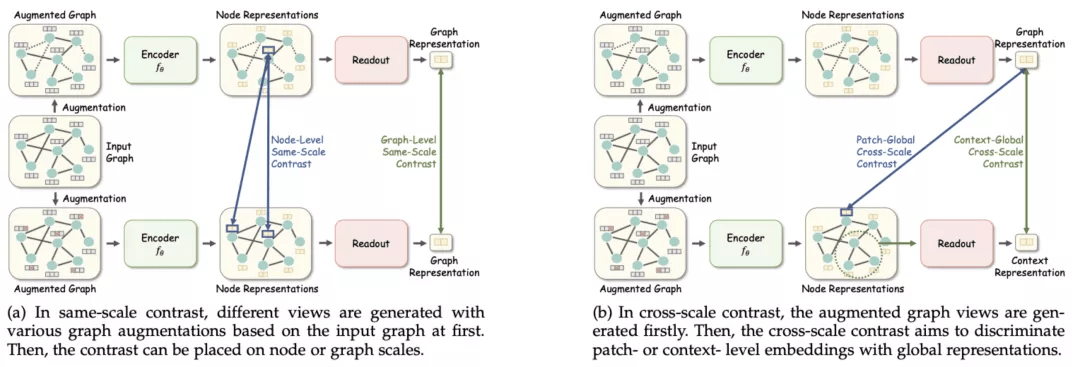

对于对比式的代理任务 , 本文通过其对比样本的尺度进行进一步细分为同尺度对比学习和跨尺度对比学习 。 其中 , 同尺度对比学习通过最大化同一节点样本或者同一图样本在不同视角下的互信息来进行自监督学习 , 此类方法包括早期的基于随机游走的图嵌入方法 , 以及一系列 CV 对比学习框架(如 SimCLR 和 MoCo)在图领域的应用方法 。 跨尺度对比学习通过最大化 “节点样本 vs 全局样本” 或者 “节点样本 vs 邻居样本” 之间的互信息来学习 , 这类方法起源于 Petar 等人与 2019 年提出的 DGI , 目前在异质图、动态图等数据上均有应用 。

文章图片

基于对比的图自监督学习

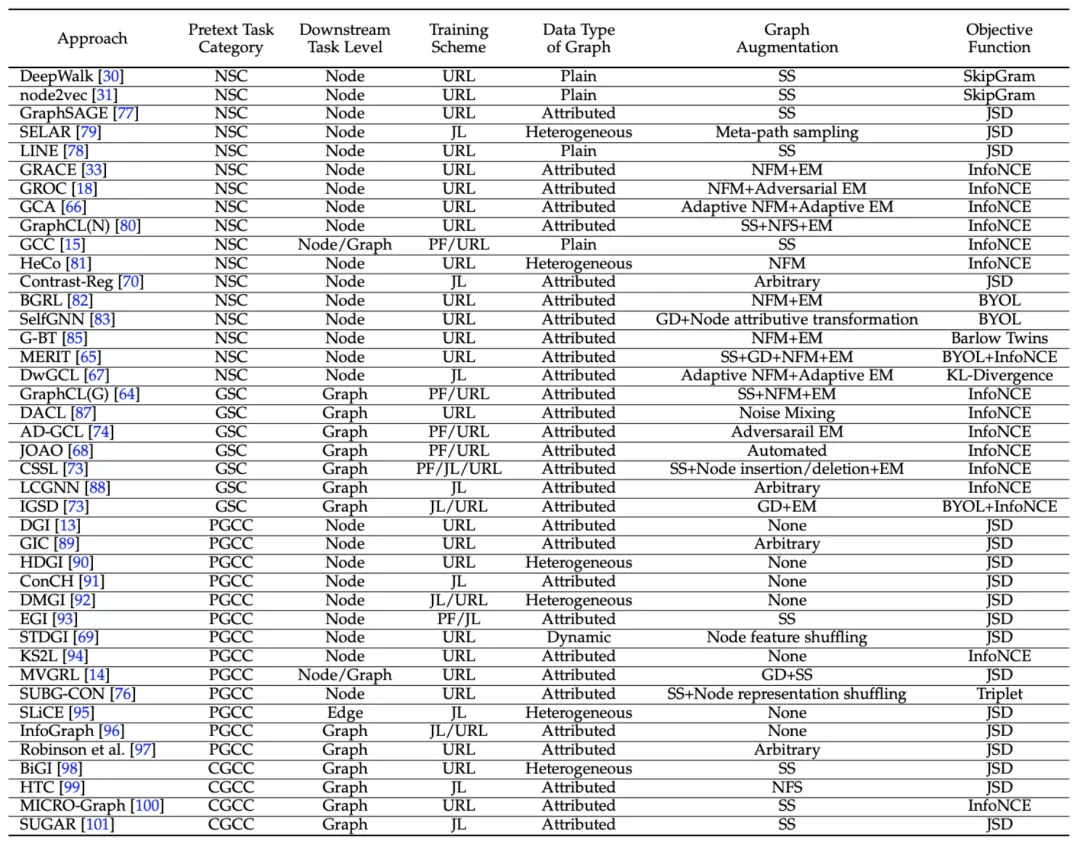

由于对比学习涉及到对互信息的估计 , 本文也从数学层面总结了几种互信息估计方法 , 包括经典的 Jensen-Shannon 散度 , InfoNCE , Triplet loss function , 以及前沿的 BYOL 以及 Barlow twins 。

基于对比的图自监督学习方法总结见下表:

文章图片

D.混合型图自监督学习方法

混合型方法结合了两种或多种不同的代理任务 , 以多任务学习的模式共同训练模型 。 常见的组合包括:结合两种生成任务(特征生成 + 结构生成)的混合方法 , 结合生成任务和对比任务的混合方法 , 结合多种对比任务的混合方法 , 以及三种任务共同参与的混合方法 。 混合型方法的总结如下表所示:

推荐阅读

- 文章|美媒文章:古人类领域2021年六大新突破

- 核心|中科大陈秀雄团队成功证明凯勒几何两大核心猜想,研究登上《美国数学会杂志》

- 器件|6G、量子计算、元宇宙…上海市“十四五”聚焦这些前沿领域

- 领域|上海市电子信息产业“十四五”规划:以集成电路为核心先导

- VIA|x86研发团队卖给Intel后 VIA出售厂房和设备:北美分部就此终结

- 前瞻|6G、量子计算、元宇宙……上海市“十四五”聚焦这些前沿新兴领域

- 团队|深信院41项科研项目亮相高交会 11个项目获优秀产品奖

- 产品|数梦工场通过CMMI V2.0 L5评估,再获全球软件领域最高级别认证加冕

- 团队|玉米和水稻基因组引导编辑效率提高3倍

- 电磁场|首届全国颠覆性技术创新大赛领域赛(青岛)举办