文章图片

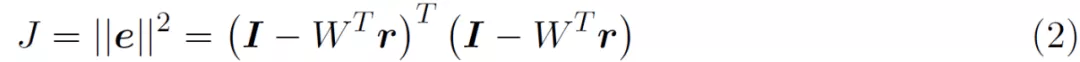

根据公式 (1a) , I 是感官输入 , 第一层表征表示为 r^(1) , 它们是等同的 。 I 和 I^ 的维度均为 256 x1(假设为 16 x 16 的输入图像块) 。 预测输入 I^ 也是等同于 r^(1) 。 预测输入表示为 W^Tr^(2) , 其中 r^(2) 的维度为 32 x 1 , W 的维度为 32 x 256 。 最后 , 在正常工作条件下 , 输入 I 和预测输入 I^ 应大致相等 。 公式 (1b) 将第 1 层的预测误差 e^(1)定义为实际输入和预测输入之间的差异 。 公式 (1c) 用于根据预测误差更新第二层的内部表征 。 从预测误差平方和的成本函数 J 开始 。

文章图片

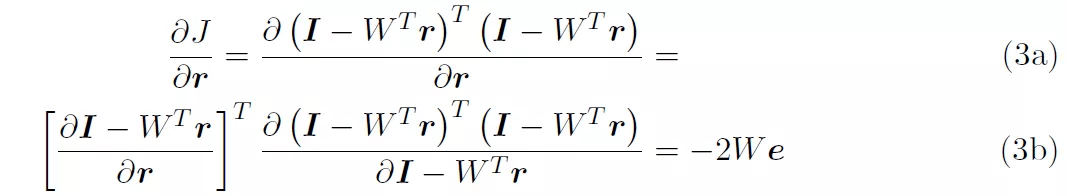

考虑到仅针对单层网络 , 为了便于阅读 , 作者在公式中省略了层上标 。 在文献 [5] 中报告的成本函数包含了先验知识 , 但公式 (2) 的成本函数并未考虑先验知识 。 为了准备梯度下降 , 我们得到了 J 对 r 的导数 。

文章图片

对于梯度下降 , 我们以一定的速率沿导数的相反方向移动:

文章图片

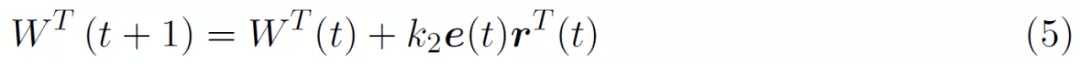

通过取 W^T 对 J 的导数 , 可得到如下所示的学习方程:

文章图片

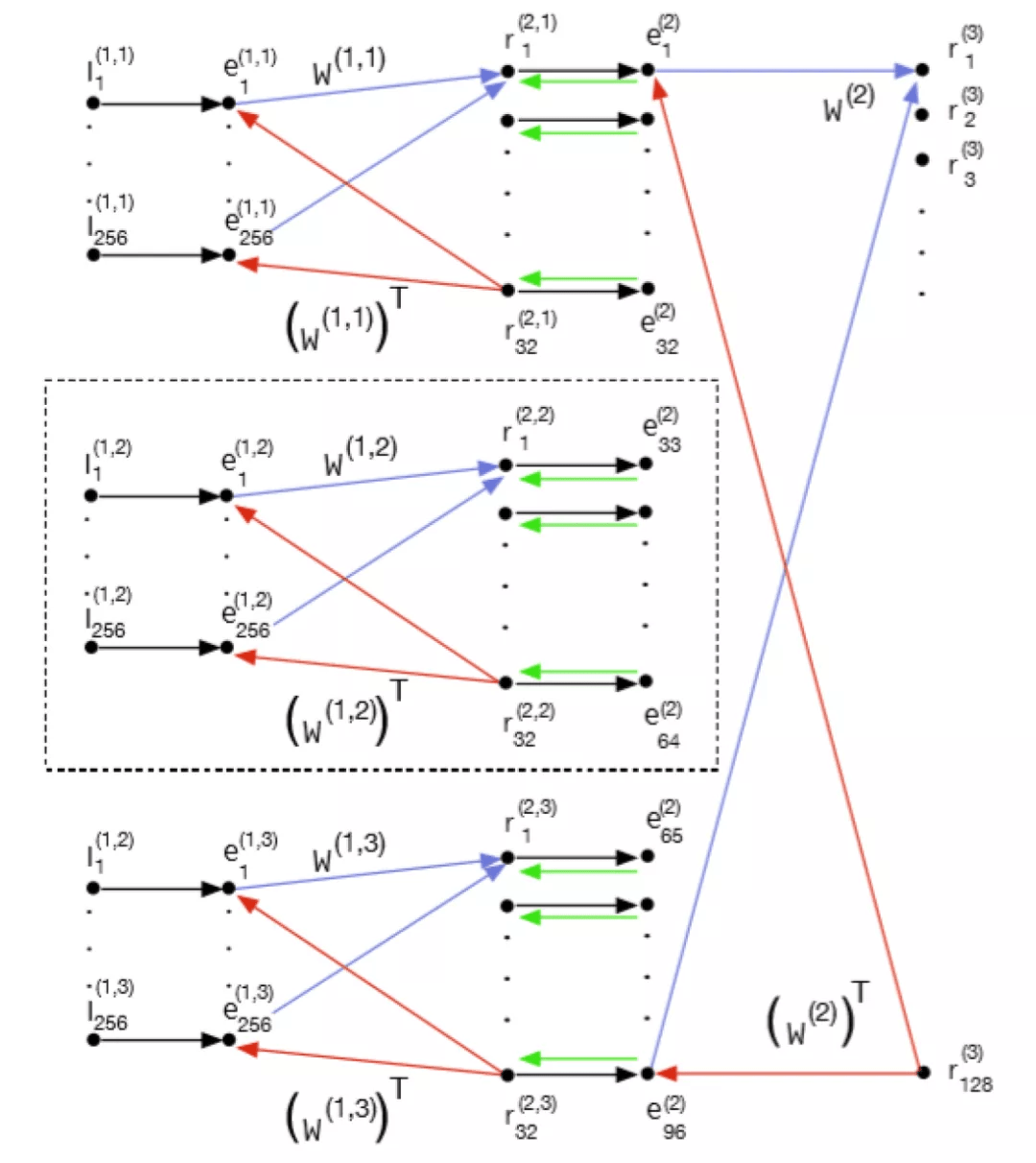

进一步的 , 给定图 2 中的模块 , 我们希望看到更大的体系结构是什么样子 , 以及当它嵌入到上下文层次结构中时会发生什么 。 为了实现这一点 , 图 3 扩展了图 2 , 在第一层中有两个横向 PE , 在第二层中增加了一个 PE 。 层 2 的输入由三个重叠的 16x16 图像块组成 。 图 2 中的神经元 (r_1)^(1)-(r_1)^(32) 与图 3 中由 (r_1)^(1,2)-(r_1)^(32,2) 识别的神经元相同 。 新添加的第 3 层接收来自第 1 层的所有 PEs 的输入 。 在图 3 中 , 第一层的中间组件对应于图 2 中的模块 。

文章图片

图 3. 扩展后的文献 [5] 中模型的全局结构 , 显示了层次结构和相邻上下文 。 图 2 中的网络位于虚线框内

3、 PredNet: 用于视频预测和无监督学习的深度预测编码网络[3]

3.1 PredNet 介绍

文献 [4] 首次提出了深度预测编码网络(deep predictive coding networks)的概念 , 而文献 [3] 中提出的模型 PredNet , 可能是使用深度学习(DL)框架实现的最早的预测编码模型 。 与上文描述的直接使用数学公式的方法相比 , 使用 DL 框架实现预测编码模型具有许多潜在优势 。

- 首先 , DL 框架非常成熟、通用且高效 。 因此 , 他们应该更容易建立和研究预测编码模型 , 唯一的复杂性是他们处理跨层反馈连接的能力 。

推荐阅读

- MateBook|深度解析:华为MateBook X Pro 2022的七大独家创新技术

- 人物|最有深度的8个公众号,你关注了吗

- 国际|特奖得主任队长,清华夺冠NeurIPS 2021国际深度元学习挑战赛

- 人物|说到做到 俞敏洪首场带货直播卖啥?

- 深度|小米真无线降噪耳机 3 Pro 新年特别版即将发布,带来全新配色等

- 语音|声控智能家居控制系统,就是人与机器的深度交流

- 系列|小米 12 系列确认搭载骁龙 8 Gen 1,已经进行深度调教

- 空间|深度阅读|王赤:从孤独里找到一束光

- 深度|2021百度奖学金十强出炉:已累计投入2000万培养中国顶尖AI人才

- 巨头|国泰君安:折叠屏手机加速渗透 供应链深度受益