社会|机器的猜想与边界( 三 )

以人为本 , 强调的是人权、隐私保护及无偏见地应用技术;技术可控 , 包含透明计算、可解释性、技术安全的边界等;可持续发展 , 追求公共善与长远发展 。

「未来的人工智能伦理治理其实就是在这三大支柱当中求得平衡」 , 徐立坚信 。

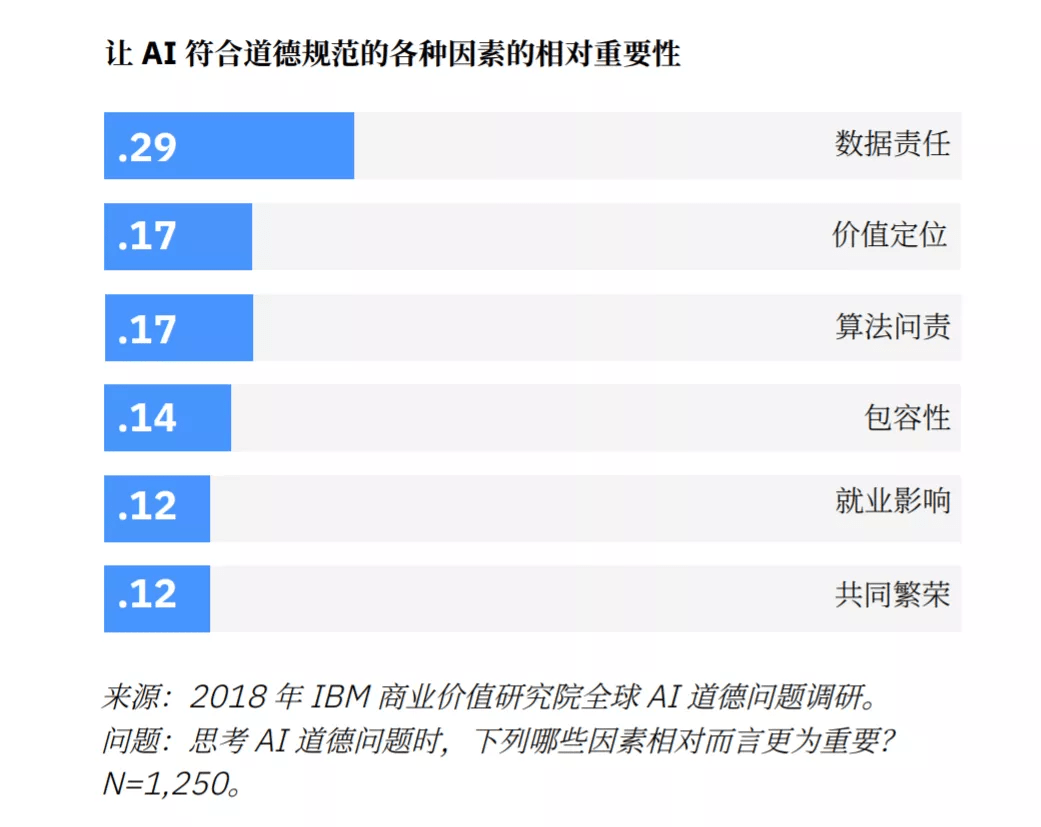

而其中 , 首当其冲的是数据与隐私保护 。 IBM 商业价值研究院曾在 2018 年与牛津经济研究院合作调查 , 发现 , 近 2/3 高管将「AI 道德」视为重要业务主题 。 位居道德风险首位的正是「数据责任」 , 包括数据所有权、存储、使用和共享 。

文章图片

「数据责任」得分差不多是排名第二 (「价值定位」)的两倍 。

在一些法律人士看来 , AI 行业在模型训练、落地应用中涉及大量数据 , 同时也要为其保障用户数据安全的能力提出更高要求 , 在数据的采集、分析、利用等各个方面均应设置严格的条件和专业的技术防火墙 。

商汤招股书显示 , 公司受客户委托就若干业务合作处理其数据 。 公司要求客户确认 , 彼等乃从合法来源获得该等数据并已取得该等数据的使用权 , 且彼等终端用户已同意协议中指定的使用目的 。 仅使用数据作客户明确授权用途 , 如身份核实、记录保存和统计数据 。

除履行或敦促敦促客户履行「通知 - 同意」基本义务 , AI 公司还应积极采用技术手段解决数据安全问题 。 《个人信息保护法》第五十一条明确规定 , 采取相应的加密、去标识化等安全技术措施;…… 人工智能企业在收集到数据后应该按照此规定对信息采取去标识化等措施 , 充分保障信息和数据的安全 。

隐私增强计算可以将数据做一些模糊化处理或者加密处理 , 然后再做计算 , 它保护到是数据本身 , 有利于突破数据保护与产业应用的难题 。

商汤也将隐私设计嵌入核心产品设计 。 例如 , 基础设施 SenseCore 训练平台集成了隐私计算技术 。

无需传输原始数据样本 , 就可以直接使用客户本地存储的数据进行模型训练 , 这能够在生产人工智能模型的同时确保数据安全、数据隐私以及监管合规 。

SenseCore 还提供数据脱敏和加密工具 , 包括数据屏蔽技术来隐去个人信息并模糊字符、数字及人脸 。 这些工具为所有经处理的数据添加了额外的隐私及安全保护层 。 确保数据用于训练时不附带任何个人信息 。

文章图片

商汤 SenseCore 三层结构图

除了基础设施 , 从主要业务层面来看 , 商汤 2B 和 2C 业务也嵌入了安全要素 。

推荐阅读

- 创事记|圈层社交的高光与隐忧:小天才电话手表会跑偏吗?

- 年味|冬奥会闭环的年味

- 新浪汽车|特斯拉回应ModelY起火:被旁边充电中的网约车引燃

- 斯达|汉威科技:目前能斯达的电子皮肤已有小批量商用

- IT|供应链受阻及检疫导致人手短缺 全球11月航空货运的增长大幅放缓

- 架构|一“融”解千愁,SASE因何成为未来网络安全的新范式?

- 市场|圈层社交的高光与隐忧:小天才电话手表真能挑战腾讯?

- 巨头|“假装”:硅谷科技巨头不愿言说的思想起源

- 市场|圈层社交的高光与隐忧:小天才电话手表会跑偏吗?

- 财联社|难逃反垄断制裁 美国法院驳回Facebook对FTC的反击